Les effets de la propagande haineuse sur Internet

Radicalisation

Pour bon nombre de personnes, la radicalisation représente la plus grande inquiétude concernant les jeunes et la haine en ligne. Ce terme renvoie au processus par lequel certaines personnes sont amenées à croire que les actes de violence envers autrui ou soi-même sont justifiés s’ils servent à défendre « leur groupe ». Le degré de radicalisation peut varier d’un membre à un autre dans un groupe. À vrai dire, dans un même groupe haineux, seul un petit nombre de personnes se radicalisent au point de militer pour la cause ou de poser des gestes de violence.

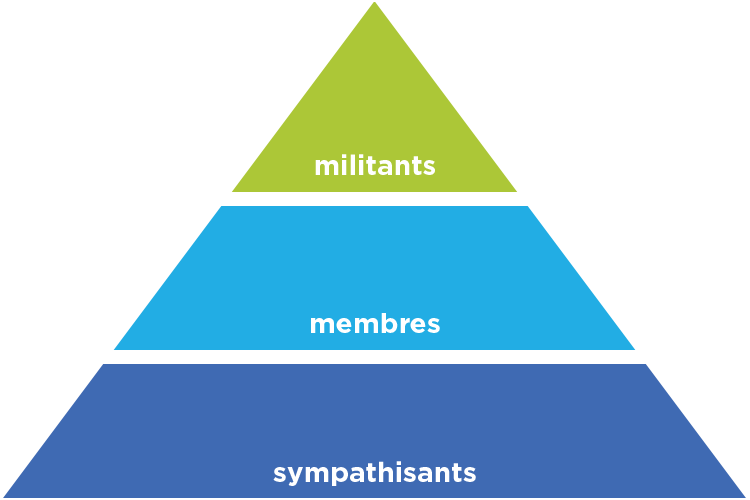

Pour mieux visualiser le processus de radicalisation, nous pourrions considérer le groupe ou le mouvement comme une pyramide[1]. (Même si plusieurs ont récemment critiqué ce modèle de radicalisation, amenant les auteurs de l’ouvrage initial à proposer un modèle à deux pyramides qui sépare la radicalisation des opinions et celle des actions[2] , il demeure un excellent modèle pour la vulgarisation des groupes radicalisés.)

La base de la pyramide est composée de sympathisants qui soutiennent le groupe et partagent les mêmes idéaux, mais qui ne participent pas activement aux activités. Ils forment habituellement la plus grande partie du groupe, mais sont souvent les moins engagés.

Au prochain niveau se situent les membres, ceux qui s’identifient fortement aux valeurs du groupe et qui participent quotidiennement aux activités.

Les militants forment la pointe de la pyramide. Ce sont des membres qui adhèrent entièrement aux idées et aux valeurs véhiculées par le groupe et qui sont susceptibles de l’amener à adopter des positions radicales ou à poser des gestes extrêmes. Les militants les plus radicaux sont ceuxqui posent des gestes violents ou criminels. Même s’il est difficile de déterminer comment chaque personne est portée à se radicaliser, il y a eu, au Canada seulement, au moins trois tueries motivées par la haine dont les auteurs avaient été partiellement radicalisés sur le Web[3] .

La radicalisation ne se produit pas toujours en ligne ou au sein de groupes haineux : les relations hors ligne avec la famille, les amis et les pairs peuvent être un facteur important, et certaines personnes peuvent se radicaliser en consommant des contenus haineux sans jamais faire partie d’une communauté ou d’un groupe organisé. Il est également important de noter que les personnes radicalisées ne passent pas toutes par ces étapes. Dans certains cas, la radicalisation se produit soudainement, sautant les étapes de sympathisant ou de membre, voire les deux.

Le processus de radicalisation a traditionnellement été perçu comme la façon dont les personnes se déplacent vers le haut de la pyramide afin de s’intégrer profondément au groupe et deviennent plus susceptibles de soutenir ou de poser des gestes extrêmes. Or, les médias numériques, par leur nature réseautée, permettent aux groupes haineux de cibler simultanément tous les niveaux de la pyramide, aussi différents soient-ils, « exposant ainsi plus facilement les spectateurs à du contenu progressivement extrémiste[4] ». Un expert a d’ailleurs décrit Internet comme étant un « convoyeur » à la radicalisation[5] . Sur les forums de discussion extrémistes, « faire avaler la pilule rouge aux autres (les radicaliser) est un thème constant de discussion ». On tente d’harmoniser le message à la réceptivité des victimes[6] .

« Les groupes haineux veulent recruter les personnes qui commencent une phrase en disant "Je ne suis pas raciste, mais…" Si elles le disent, c’est qu’elles y sont presque. Tout ce que nous avons à faire, c’est de les amener à aller un peu plus loin[7]. » – Derek Black, ancien partisan de la suprématie blanche

Les médias numériques permettent également ce que l’on appelle la radicalisation réciproque, dans laquelle le public pousse des personnalités en ligne comme les influenceurs et les youtubeurs à diffuser des messages plus extrêmes[8]. Comme l’explique la chercheuse-boursière Becca Lewis :

« Non seulement les créateurs de contenu poussent leur public vers la droite, mais l’inverse se produit également. Bien souvent, leur public, qui est déjà d’extrême droite, commence à exiger de plus en plus de contenu d’extrême droite de la part des personnes qu’il regarde. On se retrouve donc dans un cercle vicieux où le public pousse les créateurs vers la droite, tandis que les créateurs poussent également les membres de leur public vers la droite[9]. »

Cependant, il faut généralement plus d’une exposition ou plus d’un facteur d’incitation ou d’attraction pour entreprendre un parcours de radicalisation. D’anciens extrémistes rapportent notamment avoir découvert des contenus haineux en ligne par le biais d’un ami ou d’une connaissance hors ligne, une puissante combinaison des aspects idéologiques et émotionnels de la radicalisation[10]. De même, Reid Brown, aujourd’hui âgé de 21 ans, a raconté avoir vu des vidéos misogynes sur YouTube à l’âge de 13 ans et avoir constaté que les idées qu’elles contenaient étaient renforcées par des pairs qui avaient vu des contenus similaires[11]2. Selon Brad Galloway, coordonnateur du Centre on Hate, Bias and Extremism, « la radicalisation est un processus non linéaire, et Internet donne aux gens davantage d’occasions de rechercher et de consommer des contenus qui renforcent leurs doléances[12] ».

Radicalisation chez les jeunes

Les jeunes sont particulièrement vulnérables aux mécanismes cités précédemment puisqu’ils sont justement à la recherche de groupes ou de causes à soutenir, qui les aideront dans leur quête d’identité. La recherche d’identité est une étape naturelle de l’adolescence, mais à l’extrême, elle peut constituer une occasion en or pour les semeurs de haine. Le terme « anomie » est employé pour décrire l’état d’esprit selon lequel les valeurs familiales, sociales ou culturelles semblent sans valeur. Les jeunes souffrant d’anomie chercheront un groupe ou une cause qui leur donnera des valeurs, une identité ou une famille de substitution[13]. Les groupes et les mouvements haineux profitent de cette situation pour radicaliser les jeunes, un processus parfois appelé « l’effet de la pilule rouge », en référence à la scène du film The Matrix dans laquelle le personnage principal prend une pilule qui lui fera découvrir la vérité sur sa réalité[14]. Pour de nombreux jeunes, la recherche d’une identité, et d’un groupe auquel appartenir, peut être plus importante qu’une haine réelle ou un engagement idéologique[15]. Un extrémiste a déjà dit que « l’idéologie n’est pas la principale raison pour laquelle les gens rejoignent ces mouvements. L’identité, l’appartenance et le besoin de donner un sens à leur vie sont des motivations bien plus importantes[16]. »

L’une des causes fréquentes de l’anomie est le changement des conditions sociales qui donne l’impression que son identité est attaquée. C’est souvent le cas lorsque les membres de groupes historiquement favorisés (les élèves blancs, masculins, cisgenres et sans incapacité) à qui on a inculqué un idéal de « daltonisme » sont confrontés pour la première fois à l’impact réel de ces identités sur l’histoire et la société. Comme le souligne Jennifer Harvey dans son ouvrage Raising White Kids :

« Les étudiants blancs […] sont moins susceptibles d’avoir été activement nourris dans leur compréhension de la race et de sa signification dans leur vie […] Leur compréhension de la race est au mieux sous-développée et au pire, profondément confuse. Leur expérience est comparable à celle d’un élève à qui on aurait enseigné seulement l’addition de base et qui se retrouverait soudainement dans un cours de calcul[17]. »

Ce phénomène explique également pourquoi les problèmes économiques ne conduisent pas nécessairement les jeunes vers la radicalisation : une étude a permis de constater « qu’il ne s’agit pas du piètre statut socioéconomique qui mène à la susceptibilité, mais plutôt un sens de dépossession relative, combinée à des sentiments d’exclusion politique ou sociale[18]. »

Normalisation et milieux hostiles

Au-delà de la radicalisation des personnes, la nature réseautée et connectée des communautés virtuelles permet également aux groupes haineux d’élargir la base de leur pyramide afin d’y exprimer des propos haineux, tant moqueurs que sérieux, et de les faire paraître plus acceptables. Le but n’est pas seulement de créer un plus grand bassin d’éventuelles recrues, mais d’établir un milieu virtuel progressivement plus hostile pour ses victimes. Alors que les deux niveaux supérieurs sont les plus visibles et les plus inquiétants :

« La strate inférieure est tout aussi responsable de la rancœur, du pessimisme, de la mésinformation et désinformation qui obstruent les espaces virtuels, causant ainsi beaucoup de dégâts. Cette strate inférieure comprend la publication de blagues mesquines relativement à une nouvelle, à une tragédie ou à une controverse en cours de développement; le partage ironique de gazouillis liés à un canular ou à d’autres renseignements trompeurs pour les condamner, se moquer des personnes concernées ou marquer sa supériorité relativement aux personnes qui prennent ces renseignements au sérieux; faire des blagues d’initiés ambivalentes en prétextant que vos amis connaissent le fond de votre pensée (et pour les personnes de race blanche en particulier, que vos amis sauront que vous n’êtes pas véritablement racistes); identiqueter des personnes dans des blagues, des critiques ou des moqueries collectives, pour s’assurer que la cible de la discussion est au courant de ce qui se passe; et surtout, s’interposer dans des discussions sans connaissance de cause.

Tout comme dans la nature, cette strate inférieure omniprésente soutient les strates supérieures, y compris les animaux les plus dangereux de la chaîne alimentaire. De façon directe et indirecte, les lions se nourrissent des insectes[19]. »

La normalisation constitue peut-être un risque plus grand que la radicalisation : des recherches ont démontré que les médias ont peu d’impact direct sur les croyances des gens, mais s’ils modifient ce que nous pensons que les autres croient, nous modifierons nos attitudes et comportements en conséquence. Si les actions d’une minorité bruyante mènent à l’intégration de la haine dans les normes et les valeurs d’une communauté, d’autres membres de la communauté, en particulier les jeunes, peuvent être invités à adopter ces attitudes[20]. La normalisation peut aussi accroître le risque de radicalisation puisque les gens, lorsque les messages haineux deviennent plus « dominants », sont plus susceptibles de les voir et moins susceptibles de voir des réactions et des réfutations à leur sujet. En fait, la normalisation peut être interprétée comme la radicalisation de toute une communauté, voire de toute une société.

Selon le journaliste et spécialiste des médias Daniel Hallin, tout sujet ou idée susceptible d’être abordé correspond à l’une des trois sphères suivantes :

- la sphère du consensus renferme des idées qui sont si largement acceptées qu’il n’est pas nécessaire d’en discuter;

- la sphère de la déviance renferme des idées si largement rejetées qu’il n’est pas nécessaire d’en discuter;

- la sphère de la controverse légitime regroupe les idées considérées comme méritant une discussion dans les médias, les conversations polies et les débats politiques[21].

Une grande partie des efforts des groupes haineux vise à faire passer leurs messages de la sphère de la déviance et à l’une des deux autres sphères. Chaque fois qu’une personne partage un commentaire empreint de préjugés ou une image haineuse, le message finit par entrer dans la sphère du consensus de cette communauté si la plateforme ou la communauté n’agit pas.

Le but de tout mouvement de haine est de démarginaliser ses opinions et ses idées, c’est-à-dire de les faire passer de la frange extrémiste de la société au courant dominant. La nature réseautée de la technologie numérique facilite cette démarginalisation, d’abord parce que tout le monde est maintenant en mesure de publier du contenu et de le diffuser partout, et aussi parce que ce réseau de contacts facilite grandement le déplacement des idées, des opinions et du contenu entre les diverses plateformes et communautés. (Par exemple, un mème créé sur un forum de Reddit a été répété sur le site Fox News quatre jours plus tard[22].)

Les principaux médias, lesquels rejoignent encore les publics les plus nombreux (et, en particulier, le plus grand nombre d’électeurs dans la plupart des pays), jouent un rôle essentiel dans ce processus, surtout lorsqu’ils considèrent qu’un sujet discuté dans les médias sociaux constitue la preuve qu’il vaut la peine d’être mentionné dans les nouvelles. Comme l’a expliqué Farhad Manjoo, chroniqueur en technologies : « Les points de vue extrémistes, qui auparavant n’auraient jamais eu leur place dans le débat national, sont maintenant introduits par ce genre de mécanisme d’entrée. D’abord publiés sur des blogues, ils sont repris par les chaînes de nouvelles sur le câble, puis se retrouvent au cœur d’un débat national[23]. »

De même, les médias traditionnels peuvent jouer un rôle en exposant leurs publics à des termes qui, lorsqu’ils font l’objet d’une recherche, dirigent leurs visiteurs vers des contenus extrémistes. Parfois, les gens pensent bien faire. Par exemple, Anderson Cooper, présentateur à CNN, a interrogé David Hogg, survivant de la tuerie survenue à l’école de Parkland et aujourd’hui militant pour le contrôle des armes à feu, à propos des rumeurs selon lesquelles il aurait été un « acteur de crise » payé pour prendre part à un faux attentat. Comme il fallait s’y attendre, la plupart des recherches faites sur l’expression « acteur de crise » ont mené à des contenus qui appuyaient la théorie conspirationniste[24]. Il arrive aussi, cependant, que les messages de haine se propagent entre les médias qui se chevauchent sur le continuum idéologique, par exemple lorsque les idées passent des forums prônant la suprématie blanche aux personnalités d’extrême droite qui communiquent leur message sur Twitter et YouTube, aux commentateurs qui expriment des opinions conservatrices à la télévision et, enfin, aux bulletins de nouvelles télévisés destinés au grand public[25].

Ces environnements hostiles peuvent également avoir un impact direct sur les membres des groupes ciblés : par exemple, les jeunes 2SLGBTQ+ sont presque deux fois plus susceptibles de déclarer avoir été victimes d’intimidation en ligne que les hétérosexuels[26]. Les jeunes qui subissent la haine en ligne éprouvent souvent de la peur, de la colère, de la honte et une baisse de l’estime d’eux-mêmes[27], et même ceux qui sont accidentellement exposés à des contenus haineux se sentent souvent tristes, en colère, honteux ou pleins de haine[28]. Par conséquent, les membres des groupes vulnérables peuvent être plus réticents à s’exprimer librement en ligne[29] et être poussés à cacher leur identité[30] ou à se retirer complètement des espaces en ligne[31], ce qui a un impact non seulement sur eux, mais aussi sur les communautés en ligne dont ils font partie.

Doute et négationnisme

Comme les jeunes se tournent massivement vers Internet comme source d’information, ils courent le risque d’être induits en erreur par des contenus haineux. Si ces informations erronées ne sont pas remises en question, et si les jeunes n’ont pas l’esprit critique nécessaire pour le faire eux-mêmes, certains peuvent en venir à avoir des opinions dangereusement faussées. Selon le chercheur-boursier Jessie Daniels :

« Un risque beaucoup plus probable et pernicieux pour les jeunes que la mobilisation ou le recrutement dans des groupes extrémistes de suprémacistes blancs est la capacité des discours haineux en ligne de changer la façon dont nous savons ce que nous disons savoir sur des questions qui ont été politiquement gagnées de haute lutte[32]. »

Semer le doute peut servir les objectifs des groupes haineux aussi bien, voire mieux, que le négationnisme pur et simple. Les groupes haineux s’approprient souvent le langage de l’éducation aux médias, affirmant qu’ils font preuve d’esprit critique lorsqu’ils s’en prennent aux personnes transgenres, qu’ils « ne font que poser des questions » lorsqu’ils font la promotion des pseudo-sciences racistes et qu’ils « se font l’avocat du diable » lorsqu’ils minimisent le nombre de juifs morts pendant l’Holocauste[33]. Ainsi, la haine peut faire du tort non seulement aux personnes et aux communautés, mais aussi à la société elle-même, en favorisant un cynisme corrosif qui nous éloigne des moyens par lesquels nous pouvons réellement faire la différence[34].

[1] Mccauley, C., & Moskalenko, S. (2008). Mechanisms of Political Radicalization: Pathways Toward Terrorism. Terrorism and Political Violence, 20(3), 415-433. doi:10.1080/09546550802073367

[2] Mccauley, C., & Moskalenko, S. (2017). Understanding political radicalization: The two-pyramids model. American Psychologist, 72(3), 205-216. doi:10.1037/amp0000062

[3] Carranco, S., & Milton, J. (2019, April 27). Canada’s new far right: A trove of private chat room messages reveals an extremist subculture. The Globe and Mail. Retrieved from https://www.theglobeandmail.com/canada/article-canadas-new-far-right-a-trove-of-private-chat-room-messages-reveals/

[4] Lewis, B. (2018). Alternative Influence: Broadcasting the Reactionary Right on YouTube (Rep.). Data & Society.

[5] Bergin, A.. Countering Online Radicalisation in Australia. Australian Strategic Policy Institute Forum, 2009.

[6] From Memes to Infowars: How 75 Fascist Activists Were "Red-Pilled". (2018, October 11). Retrieved April 25, 2019, from https://www.bellingcat.com/news/americas/2018/10/11/memes-infowars-75-fascist-activists-red-pilled/

[7] NPR (2018). “How A Rising Star Of White Nationalism Broke Free From The Movement.” Retrieved from https://www.npr.org/transcripts/651052970 [traduction]

[8] Marwick, A., & Lewis, R. (2017). Media manipulation and disinformation online. New York: Data & Society Research Institute.

[9] Quoted in Thakker, P. “Under the Hood of the Right-Wing Media Machine.” Better World. https://betterworld.substack.com/p/under-the-hood-of-the-right-wing-media-machine [traduction]

[10] Gaudette, T., Scrivens, R., & Venkatesh, V. (2022). The role of the internet in facilitating violent extremism: insights from former right-wing extremists. Terrorism and Political Violence, 34(7), 1339-1356.

[11] Wilson, B. (2022) How young men fall into online radicalization. CBC News.

[12] Kalantzis, D. (2020) What We Get Wrong About Online Radicalization. Vox Pol. https://www.voxpol.eu/what-we-get-wrong-about-online-radicalization/ [traduction]

[13] Amon, K. (2010). Grooming forTerror: the Internet and Young People. Psychiatry, Psychology& Law, 17(3), 424-437.

[14] Evans, R. From Memes to Infowars: How 75 Fascist Activists Were “Red-Pilled”. (2018, October 11). Retrieved April 25, 2019, from https://www.bellingcat.com/news/americas/2018/10/11/memes-infowars-75-fascist-activists-red-pilled/

[15] Gaudette, T., Scrivens, R., & Venkatesh, V. (2022). The role of the internet in facilitating violent extremism: insights from former right-wing extremists. Terrorism and Political Violence, 34(7), 1339-1356.

[16] Carr, J. (2022) The Rise Of Ideologically Motivated Violent Extremism In Canada. Report of the Standing Committee on Public Safety and National Security. [traduction]

[17] Harvey, J. (2018). Raising white kids: Bringing up children in a racially unjust America. Abingdon Press. [traduction]

[18] Norman, J. M., & Mikhael, D. (2017, August 28). Youth radicalization is on the rise. Here’s what we know about why. Washington Post. Retrieved September 1, 2017, from https://www.washingtonpost.com/news/monkey-cage/wp/2017/08/25/youth-radicalization-is-on-the-rise-heres-what-we-knowabout-why/?utm_term=.39a485789d43

[19] Milner, R. M., & Phillips, W. (2018, November 20). The Internet Doesn't Need Civility, It Needs Ethics. Retrieved from https://motherboard.vice.com/en_us/article/pa5gxn/the-internet-doesnt-need-civility-it-needs-ethics

[20] Bursztyn, L., Egorov, G., & Fiorin, S. (2020). From extreme to mainstream: The erosion of social norms. American economic review, 110(11), 3522-3548.

[21] Hallin, D. C. (1989). The “Uncensored War”: The Media and Vietnam. New York: Oxford University press. pp. 116–118. ISBN 0-19-503814-2.

[22] Collins, K., & Roose, K. (2018, November 4). Tracing a Meme From the Internet’s Fringe to a Republican Slogan. The New York Times. Retrieved April 26, 2019, from https://www.nytimes.com/interactive/2018/11/04/technology/jobs-not-mobs.html

[23] Does the Internet Help or Hurt Democracy [Television series episode]. (2010, June 1). In News Hour. PBS.

[24] Boyd, D. (2019, April 24). The Fragmentation of Truth. Retrieved April 26, 2019, from https://points.datasociety.net/the-fragmentation-of-truth-3c766ebb74cf

[25] Daniels, J. (2019, April 9). UN Keynote Speech: Racism in Modern Information and Communication Technologies. Presented to the 10thsession of the Ad Hoc Committee on the Elaboration of Complementary Standards to the International Convention on the Elimination of All Forms of Racial Discrimination. Geneva.

[26] MediaSmarts. (2023). “Young Canadians in a Wireless World, Phase IV: Relationships and Technology - Online Meanness and Cruelty.” MediaSmarts. Ottawa.

[27] Kerr, M., St-Amant M. & McCoy, J. (2022) Don't Click! A Survey of Youth Experiences with Hate & Violent Extremism Online.

[28] Kowalski, K. (2021) How to fight online hate before it leads to violence.

[29] Lenhart, A., Ybarra, M., Zickhur, K., & Price-Feeney, M. (2016). Online Harassment, Digital Abuse, and Cyberstalking in America (Rep.). New York, NY: Data & Society. doi:https://www.datasociety.net/pubs/oh/Online_Harassment_2016.pdf

[30] Joseph, J. (2022) #Blockhate: Centering Survivors and Taking Action on Gendered Online Hate in Canada. YWCA Canada.

[31] Resnick, B. (2017, March 07). The dark psychology of dehumanization, explained. Retrieved from https://www.vox.com/science-and-health/2017/3/7/14456154/dehumanization-psychology-explained

[32] Daniels, J. (2008). Race, civil rights, and hate speech in the digital era.

[33] Fister, B. (2021) Lizard People in the Library. Project Information Literacy. https://projectinfolit.org/pubs/provocation-series/essays/lizard-people-in-the-library.html

[34] Neiwert, D. (2020). Red pill, blue pill: How to counteract the conspiracy theories that are killing us. Rowman & Littlefield.